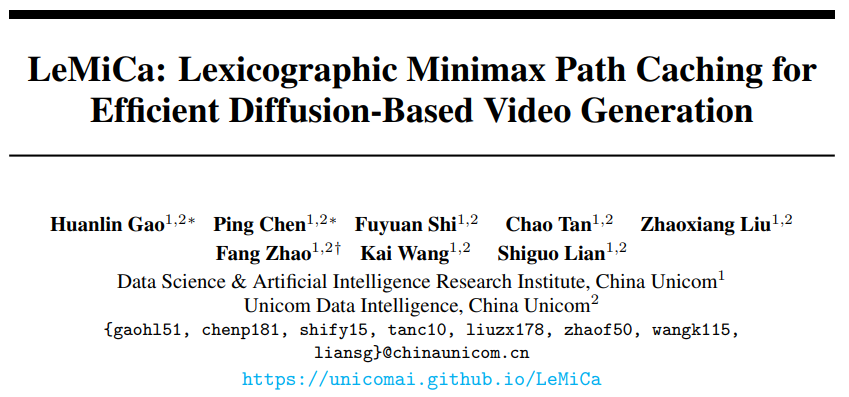

�Ї�ͨ�����ƌW�c�˹������о�Ժ�Ƽ����³ɹ������ٶ�ȡ��ͻ�ƣ�������_Դȫ�Uɢģ�ͼ��ٿ��LeMiCa��Lexicographic Minimax Path Caching�����õ��W�g���J�ɣ����x���H�˹�����픕�NeurIPS 2025 Spotlight��ȫ���^2�fƪͶ���У��H3.1%���x�������H��ˣ�߀�@����ͨ�xǧ�������VAI�ăA�����]���քe����ٷ�����ό�LeMiCa�M��չʾ��

NeurIPS��Conference on Neural Information Processing Systems������Ϣ̎��ϵ�y���������ȫ��C���W�����˹������I�����Ӱ����ČW�g���h֮һ��CCF-A��h�����ݺ��w�˹������I��ęC���W������ȌW����Ӌ��Cҕ�X����Ȼ�Z��̎����AI for Science�ȶ����I����ԓ���h��NIPS��������k��ʼ��1987�ꡣNeurIPS��Փ���ȡ����20%-25%���ң�spotlight���ȡ����3%-4%���ҡ�

��Փ�����x��

��QWen-Image��

�����VAI CogVideoX��

��ģ�B����ģ�͡��족�c�������ă��y

��ǰ���Թȸ� Nano-Banana��OpenAI Sora2 �Ȟ�����������D������ҕ�lģ�������ٰlչ���������R���족�c�������ă��y�������|��������ٶ�����Ӱ�Ҏģ�����á�

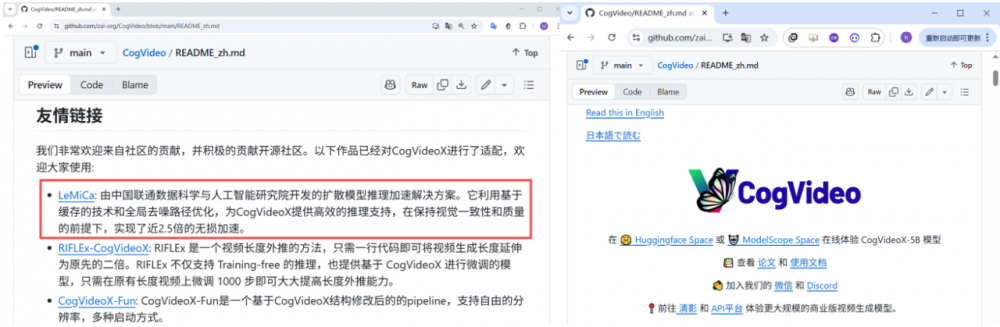

�V��ʹ�õĔUɢģ�ͣ�Diffusion Model���ܘ�ͨ�^�ಽ�����ɘ�ȥ�����Ƀ��ݣ�ÿ������ȫ��Ӌ�㣬�������ɺĕr�L���ɱ��ߡ��I�������ľֲ�؝�ľ��棨Local-Greedy Caching������������ͨ�^�ھ�Ӌ����ֵ�Д����F������ã�����ȫ��Ӌ�㣬����ֻ�Pע�ֲ������á���һ����һ�������ԣ������۷e�`����Ƀ���ʧ�档

LeMiCaͨ�^ȫ�փ���ͻ�ƃ��yƿ�i

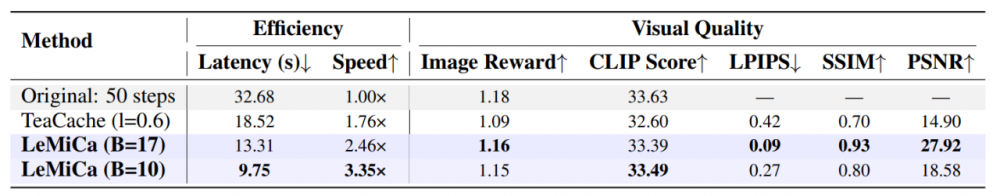

�Ї�ͨ�����ƌW�c�˹������о�Ժ�Ƴ���LeMiCa������ͨ�^�ں��˹�����c�����ӵĄ��·���Փ���������ٶ����� 2 �����ϣ�ͬ�r���ָ��|������Ч����

LeMiCa��ȫ��ҕ�ǃ�������·��������Ȝp���۷e�`��о�Ժͨ�^�������l�F��ԭʼ�����ɘӲ��E���пɏ����ԣ����N���ɿ粻ͬ��ʾ�~��ȫ��Ҏ�ɣ�������ͨ�^�˹�����x������ȫ���·�����c�����ӵ�ģ���ھ�������Y�ϣ��ڲ��~�����������ĕr��ǰ���£����F��Ч���١�

LeMiCa �ஔ�ھ߂�ȫ���{�������ġ����ݡ��������������ٶȵ�ͬ�r���֮����|�����L���c�����ĸ߶�һ���c�B؞��

�� LeMiCa �����㷨�Dʾ��

����C���������o�p����

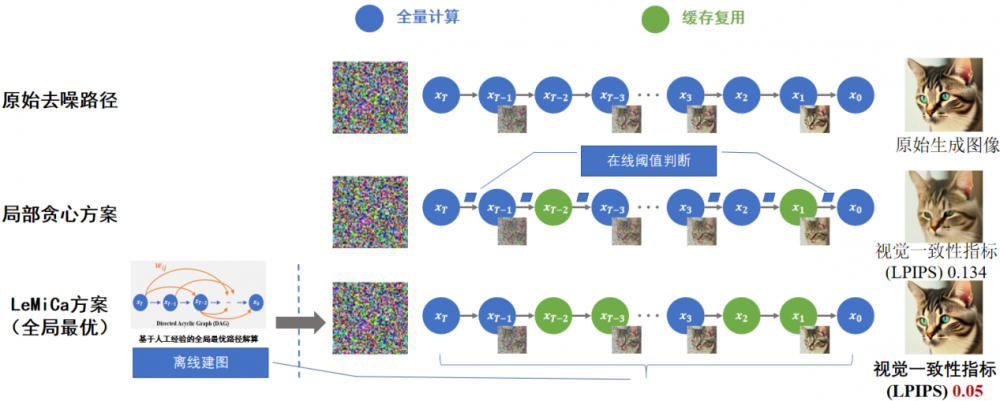

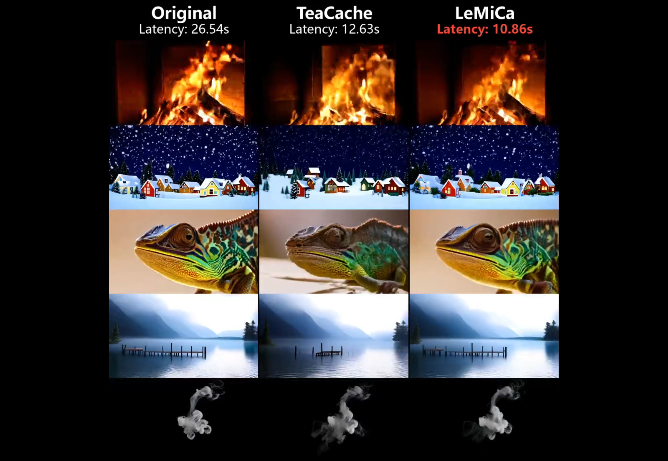

ҕ�l���ɣ���Open-Sora �� CogVideoX�ȶ������ҕ�l����ģ���ϣ���������ٱ��£�LeMiCa���ɵ�ҕ�l��LPIPS��SSIM��PSNR��ָ���Ͼ��@����Խ����������ҕ�l�|���o�ӽ�ԭʼҕ�l�����F���|�����٣����D��

������Ч�������ϣ�LeMiCa �H�� 10.86s ���ɽӽ�ԭʼ�����ĕr26.54s���ɵ�Ч�����|�����@���ںĕr�ӽ��������������w�F������Ч���ϵ�ͻ�����ݡ�

�D�����ɣ�LeMiCa �ļ�������ͬ���m���������D�΄գ��о�Ժ��피��_Դģ�� Qwen-Image �ό��F��Ч�����m�䡣�������ٶ����� 3 ������r�£��D���|���c�Z�xһ����ָ�˽ӽ�ԭʼģ�ͣ����Ҽ��������c�DƬ�|�����@���������������������C�� LeMiCa ��ͨ�����c�����ܣ����D��

��LeMiCa��Qwen-Image�ṩ��Ч�������٣�

�@Щ���Y����C��LeMiCa�ڶ�ģ�B�����΄յĸ�Ч�������������������ØO�ͳɱ���ֱ�ӌ��ӬF�е�ģ�ͼܘ����@��ζ�����oՓ�LjDƬˇ�g������AIGCҕ�lƽ�_�����������ɣ�߀�ǹ��I�OӋ���Ą���Ƭ�Ȉ������������p�ɽ���LeMiCa�����F�ͳɱ����ٺ��|�����ɡ�

LeMiCa�F��ȫ�漯����ͨԪ��MaaSƽ�_��֧�������D���D��������ҕ�l�ȶ��ģ�ͷ��գ������Ą���Ʒ���ȶ����ИI��������ؑ��á�